- CEO-ul Nvidia, Jensen Huang, spune că ideea datacentrelor orbitale este promițătoare, dar încă neprofitabilă

- Comentariile au fost făcute în timpul conferinței despre rezultatele financiare ale companiei

- În spațiu există energie solară abundentă și mult loc pentru infrastructură

- Problema majoră este răcirea procesoarelor, deoarece în orbită nu există aer

- Cererea explozivă pentru inteligență artificială determină companiile să exploreze inclusiv infrastructură spațială

Pe măsură ce inteligența artificială cere tot mai multă putere de calcul, industria tehnologică începe să ia în calcul soluții care până de curând păreau science-fiction. Una dintre ele: centre de date pentru AI plasate direct pe orbită.

Advertisment

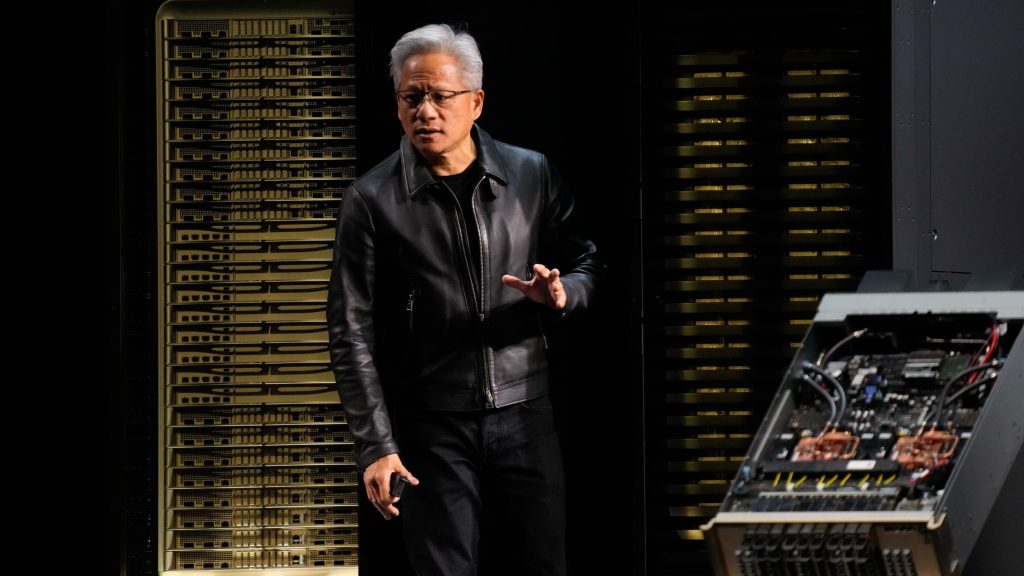

În timpul conferinței privind rezultatele financiare ale Nvidia, CEO-ul Jensen Huang a fost întrebat despre această idee tot mai discutată în Silicon Valley.

Răspunsul lui a fost realist: conceptul are potențial, dar nu este încă rentabil.

„Economia este slabă astăzi, dar se va îmbunătăți în timp”, a spus Huang, potrivit relatărilor din presa financiară precum MarketWatch și Yahoo Finance.

Motivul pentru care ideea continuă totuși să atragă interes este simplu: spațiul oferă resurse greu de egalat pe Pământ.

În orbită există:

- energie solară aproape constantă, fără nopți sau condiții meteo;

- spațiu practic nelimitat pentru infrastructură de mari dimensiuni.

Teoretic, aceste avantaje ar putea permite construirea unor super-datacentere AI alimentate direct de soare.

Fără aer, fără ventilatoare: de ce răcirea devine un coșmar tehnic

Problema apare exact acolo unde nu te-ai aștepta: răcirea computerelor.

Pe Pământ, serverele din centrele de date folosesc ventilatoare, aer condiționat sau sisteme de răcire lichidă pentru a elimina căldura generată de procesoare.

În spațiu însă, nu există aer.

„Nu există flux de aer, iar singura modalitate de a elimina căldura este prin conducție”, a explicat Huang în discuția cu investitorii.

Asta înseamnă că un datacenter orbital ar avea nevoie de radiatoare uriașe pentru a disipa căldura generată de procesoarele AI — componente care pot consuma sute de wați fiecare.

Pe scurt: hardware-ul ar putea funcționa în spațiu, dar infrastructura necesară pentru răcire ar deveni masivă și costisitoare.

Totuși, Nvidia are deja experiență cu hardware în orbită. Huang a menționat că unele GPU-uri ale companiei, inclusiv din arhitectura Hopper, au fost deja trimise în spațiu în proiecte experimentale.

Goana globală după putere de calcul pentru AI

Interesul pentru datacentere spațiale vine dintr-o realitate economică: cererea pentru putere de calcul crește exploziv.

Modelele moderne de inteligență artificială — de la modele lingvistice la sisteme de generare video — necesită mii sau chiar zeci de mii de GPU-uri pentru antrenare și operare.

Asta înseamnă:

- centre de date din ce în ce mai mari,

- consum energetic uriaș,

- presiune asupra rețelelor electrice și asupra infrastructurii de răcire.

Din acest motiv, unele companii și investitori explorează ideea mutării unei părți din această infrastructură în spațiu, unde energia solară este mult mai accesibilă.

Investitorul tech Gene Munster, de la Deepwater Asset Management, a interpretat comentariile lui Huang ca pe un semnal pozitiv pentru viitorul conceptului.

Pe platforma X, el a rezumat poziția CEO-ului Nvidia astfel: centrele de date orbitale sunt dificile astăzi, dar merită urmărite pe termen lung.

Citește și

- Un templu budist din Kyoto introduce „Buddharoid”, un robot umanoid cu Inteligență Artificială. Călugărul-robot răspunde la întrebări despre anxietate și sensul vieții

- Mark Cuban: AI a deschis era în care un copil poate schimba lumea

- Meta închide Messenger.com în aprilie 2026. Sfârșitul ușii laterale către Messenger pe desktop

Partenerii noștri