- CERN integrează inteligența artificială direct în hardware pentru decizii ultra-rapide

- Acceleratorul LHC generează un volum de date imposibil de stocat integral

- Doar aproximativ 0,02% din date sunt păstrate pentru analiză științifică

- Algoritmii decid în zeci de nanosecunde ce evenimente merită salvate

- Viitorul accelerator va produce de 10 ori mai multe date, crescând presiunea pe AI

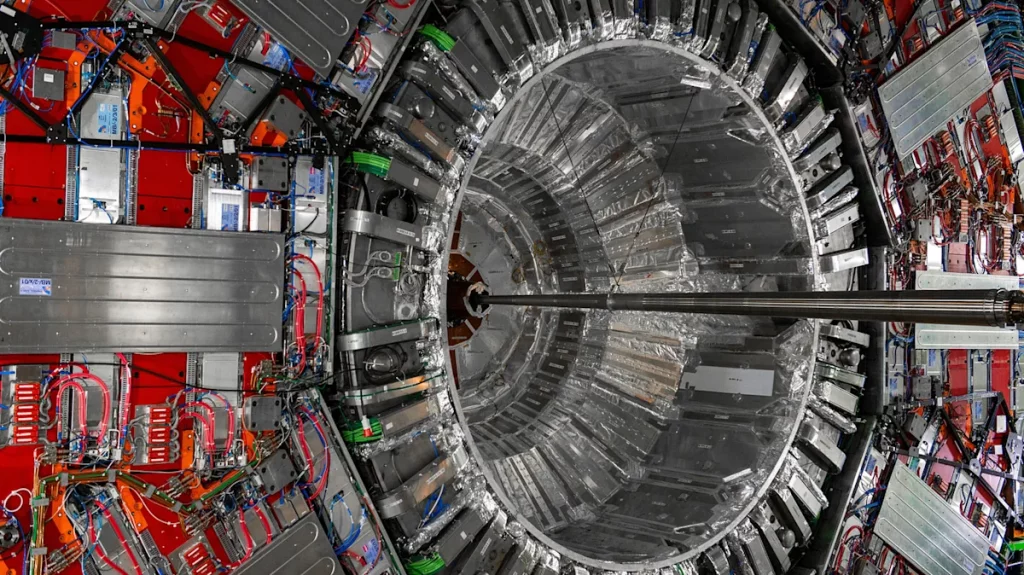

La granița dintre Elveția și Franța, într-un tunel circular de 27 de kilometri, Large Hadron Collider (LHC) produce unele dintre cele mai spectaculoase experimente din știință — dar și una dintre cele mai mari probleme de date din lume.

La fiecare secundă, aproximativ un miliard de coliziuni între particule generează un flux uriaș de informații. Fiecare coliziune produce doar câțiva megabytes, dar împreună acestea ajung la sute de terabytes pe secundă.

Potrivit datelor prezentate de cercetătoarea Thea Aarrestad (ETH Zurich), volumul anual de date brute ajunge la aproximativ 40.000 exabytes — o cantitate comparabilă cu o parte semnificativă din întreg internetul global.

Concluzia este simplă și brutală: CERN nu poate păstra tot. De fapt, nici nu încearcă.

Cum a ajuns CERN să transforme inteligența artificială în hardware, nu software

În majoritatea aplicațiilor moderne, inteligența artificială rulează în cloud sau pe plăci grafice (GPU). La CERN, această abordare nu este suficient de rapidă.

Aici, timpul de reacție nu se măsoară în milisecunde, ci în nanosecunde.

Soluția a fost radicală: algoritmii nu mai sunt doar rulați pe hardware, ci sunt integrați direct în cipuri specializate — FPGA-uri și ASIC-uri. Practic, AI-ul devine parte din circuitele fizice.

Această arhitectură elimină întârzierile cauzate de transferul de date și permite luarea deciziilor instant, exact acolo unde informația este generată.

Pentru a funcționa în aceste condiții, modelele AI sunt reduse la esență: simplificate, comprimate și optimizate pentru viteză maximă, nu pentru complexitate.

Cum decide AI-ul, în fracțiuni de microsecundă, ce merită păstrat

În centrul acestui sistem se află un mecanism numit „trigger”, care acționează ca un filtru extrem de strict.

Primul nivel analizează fluxul de date în timp real și elimină peste 99,7% din informații. Decizia este binară: păstrezi sau arunci — fără a doua șansă.

Algoritmul folosește detecția de anomalii: este antrenat să recunoască tiparele obișnuite din fizica particulelor și să semnaleze deviațiile rare, care ar putea indica descoperiri noi.

Totul se întâmplă în aproximativ 50 de nanosecunde.

Dintr-un miliard de coliziuni pe secundă, doar aproximativ 110.000 trec de primul filtru. După o a doua etapă de analiză, rămân în jur de 1.000 de evenimente pe secundă — cele considerate relevante pentru cercetare.

Aceste date sunt apoi trimise către sute de centre din întreaga lume, unde sunt analizate în detaliu.

De ce viitorul fizicii depinde de a arunca aproape toate datele

Paradoxal, progresul în fizica particulelor depinde de capacitatea de a ignora majoritatea informației generate.

CERN caută evenimente extrem de rare — uneori unul la un trilion de coliziuni. Pentru a le găsi, sistemele trebuie să fie nu doar rapide, ci și extrem de selective.

Această provocare va deveni și mai intensă odată cu lansarea High-Luminosity LHC, programată pentru începutul anilor 2030. Noul accelerator va crește de aproximativ 10 ori volumul de date și complexitatea experimentelor.

În loc să construiască modele AI mai mari, cercetătorii merg în direcția opusă: modele mai mici, mai rapide și mai eficiente, capabile să ia decizii instant.

Într-un univers în care fiecare coliziune ar putea ascunde o descoperire majoră, cea mai importantă abilitate nu este să analizezi tot — ci să alegi, corect și rapid, ce merită analizat.